知乎上有很多关于“如何判断女朋友是否生气”之类的问题,有人回答:字越少,事越大;还有人说:真生气,一个月不联系;假生气,会撒娇说“我生气了”。

“女朋友是生气了么?”是千古难题

所以,女朋友的“我没生气,真的没生气”=“很生气”;“我生气了”=“撒娇,没生气,亲亲抱抱举高高嘛”。这样的情绪逻辑让直男们抓狂。

究竟应该怎么样才能听出女朋友到底生气了没呢?

据说,AI 已经在听音识情绪上做出成绩,可能比男生抓耳挠腮地琢磨半天的结果更准确。

Alexa 语音助手:正在修炼成为暖男

亚马逊语音助手Alexa在感知情绪方面,可能比男朋友还机智。

今年,经过最新升级后,Alexa已经能够通过分析用户指令的高低和音量等反应,识别出快乐、高兴、愤怒、悲伤、烦躁、恐惧、厌恶、厌倦甚至压力等情绪,并对相应指令做出回应。

比如,如果一个女生一边擤鼻涕一边咳嗽一边又跟Alexa说自己有点饿了,那么Alexa就会通过对女生说话的的音调(虚弱、低沉)和背景音(咳嗽、擤鼻涕)分析出她很可能得病了,然后发出来自机器的贴心关怀:要不要来碗鸡汤,或者叫个外卖?甚至直接线上订购一瓶止咳糖浆一小时内送货上门?

这表现,是不是比钢铁直男男朋友还贴心?

人工智能做情绪分类已不是什么新鲜事了,不过,最近,亚马逊Alexa Speech团队前段时间打破了传统方法,发表了新的研究成果。

传统的方法都是有监督的,其获取的训练数据已经根据说话者的情绪状态被标记过。而亚马逊 Alexa Speech 团队的科学家最近采用了一种不同的方法,他们在国际声学,语音和信号处理会议(ICASSP)上发表了介绍这种方法的论文《Improving Emotion Classification through Variational Inference of Latent Variables》(http://t.cn/Ai0se57g)

他们没有采用详尽注释过“情感”的语料库来训练系统,而是提供了一个对抗自编码器(AAE)。这是一个包含来自10个不同发言者的10,000个话语的公开数据集。

他们得到的研究结果是,在判断人们的声音中的效价(emotion valence)或情感价值(emotional value)时,神经网络的准确度提高了 4%。在团队的努力下,通过用户声音,便能可靠地确定用户的心情或情绪状态。

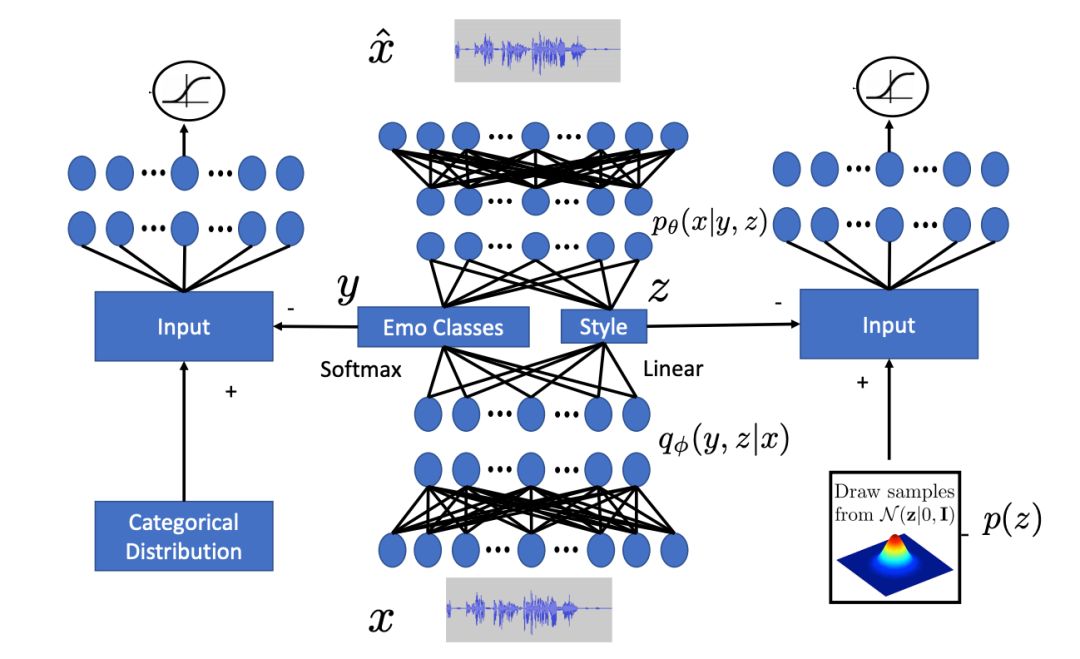

▲AAE 模型原理示意图

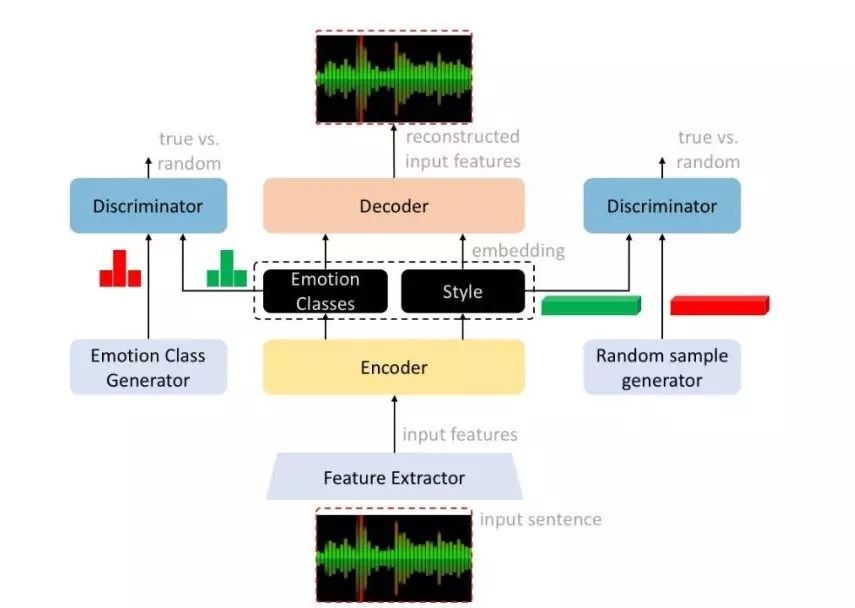

论文的共同作者,Alexa Speech 组高级应用科学家 Viktor Rozgic 解释道,对抗自编码器是包含编码器的两部分模型——编码器(encoder)和解码器(decoder)。编码器学习生成输入语音的紧凑(或潜在)表示,编码训练示例的所有属性;而解码器重建来自紧凑表示的输入。

▲对抗自编码器的架构

研究人员的情绪表征由三个网络节点组成,三个网络节点分别用于三种情绪测量:效价,激活(activation,说话者是警觉的,投入的还是被动的),以及支配(说话者是否感觉被周边局面控制)。

训练分三个阶段进行。第一阶段使用无标签的数据单独训练编码器和解码器。第二阶段为对抗训练,对抗性鉴别器试图区分编码器产生的真实表示与人工表示的技术,该阶段用于调整编码器。在第三阶段,调整编码器以确保潜在情绪表示,来预测训练数据的情绪标签。

为了捕获有关语音信号的信息,在涉及句子级特征表示的hand-engineered实验中,他们的 AI 系统在评估效价方面比传统训练网络的准确度提高了 3%。

此外,他们表示,当向网络提供一组表示20毫秒帧(或音频片段)声学特性的序列时,效果提高了 4%。

MIT 实验室打造神经网络 1.2 秒感知愤怒

亚马逊不是唯一一家研究改进的基于语音的情绪检测的公司。麻省理工学院媒体实验室Affectiva最近演示了一个神经网络SoundNet:可以在短短 1.2 秒内(已经超越人类感知愤怒所需时间)将愤怒与音频数据分类,并且无论哪种语言。

▲Pixabay

Affectiva 的研究人员在新论文《Transfer Learning From Sound Representations For Anger Detection in Speech》(https://arxiv.org/pdf/1902.02120.pdf)中描述了该系统。它建立在语音和面部数据打造情感档案的基础上。

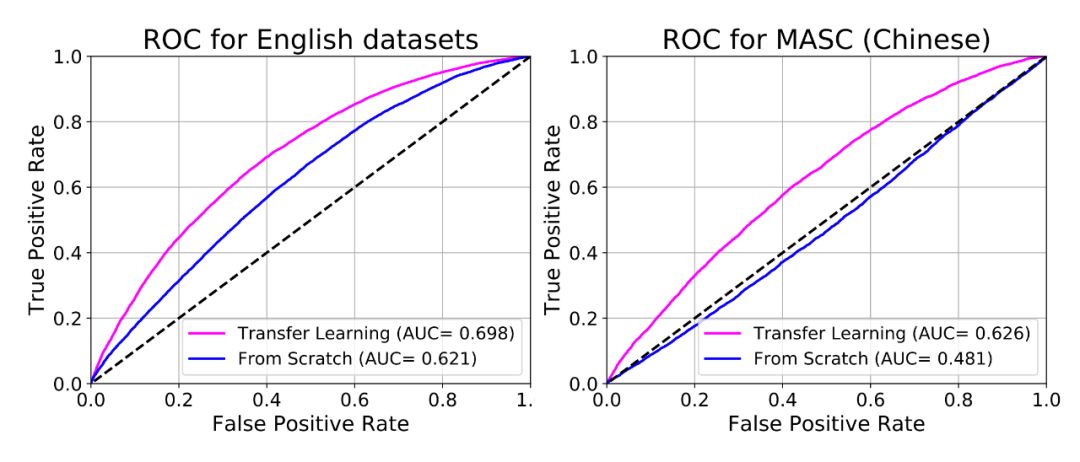

为了测试AI模型的通用性,该团队使用以英文训练的模型,对普通话语音情感数据训练的模型(普通话情感语料库,简称MASC)进行了评估。结果它不仅可以很好地推广到英语语音数据,对汉语数据也很有效,尽管性能略有下降。

▲针对英文与中文的训练结果 ROC 曲线,虚线表示随机分类器的 ROC

团队表示,“识别愤怒应用广泛,包括会话界面和社交机器人,交互式语音应答(IVR)系统,市场研究,客户代理评估和培训,以及虚拟现实和增强现实。”

未来的工作将开发其他大型公共语料库,并为相关的基于语音的任务训练 AI 系统,例如识别其他类型的情绪和情感状态。

以色列 App 识别情绪:准确率 80%

以色列创业公司 Beyond Verbal 开发了一款名为Moodies 的应用,它能够通过麦克风采集说话者的声音,经过 20 秒左右的分析,判断说话者的情绪特征。

Moodies 拥有一套特殊的算法,软件会对说话者的节奏、时间、声音大小、停顿以及能量等情绪维度进行分析

尽管语音分析专家承认语言与情绪具有相关性,但不少专家却质疑这种实时测算的准确性——这类工具收集到的声音样本非常有限,实际的分析可能需要收集数年的样本。

“以目前认知神经学的水平,我们根本没有技术真正地了解一个人的思想或者情感。”哥伦比亚大学心理学教授助理Andrew Baron说道。

不过Beyond Verbal负责市场的副总裁Dan Emodi表示,Moodies 经过了三年多的研究,根据用户的反馈,应用分析的准确率约为 80%。

Beyond Verbal公司表示,Moodies可以应用于自我情绪诊断、客服中心处理顾客关系甚至检测求职者是否说谎,当然你也可以带到约会的场景中,看对方是否真的对自己感兴趣。

语音情绪识别依然面临挑战

虽然很多科技公司已经在这方面有着多年的研究,也得到不错的成果。但是,正如Andrew Baron所质疑的,这项技术还面临多个挑战。

就像女朋友一句平静的“我没生气”并不代表她真的没生气一样,一个发音中可以包含多种感情,不同情感的边界也难以界定,哪个情绪是当前主导的情绪?

并不是所有的语气都像视频中这样明显与激烈,表达情感是一个个性化极强的事情,根据个人,环境甚至文化差异都很大。

此外,一种情绪可能持续很长时间,但期间也会有快速变化的情绪,情感识别系统是检测长期的情绪还是短时的情绪呢?比如某人限于失业的痛苦中,但期间因为朋友的关心短暂开心了一下,但实际上他仍处于伤心状态,AI 该怎么定义他的状态呢?

而另一个令人担心的事是,当这些产品能够听懂人的情绪后,是否会因为用户对它的依赖,而询问更多隐私性的问题,获取用户多方面信息,从而将“服务”变成“买卖”?

愿你会拥有大白,也拥有真正懂你的人

很多人都想拥有一个温暖又贴心的大白,这个在科幻动画里才有的高情商机器人,未来是否会成真呢?

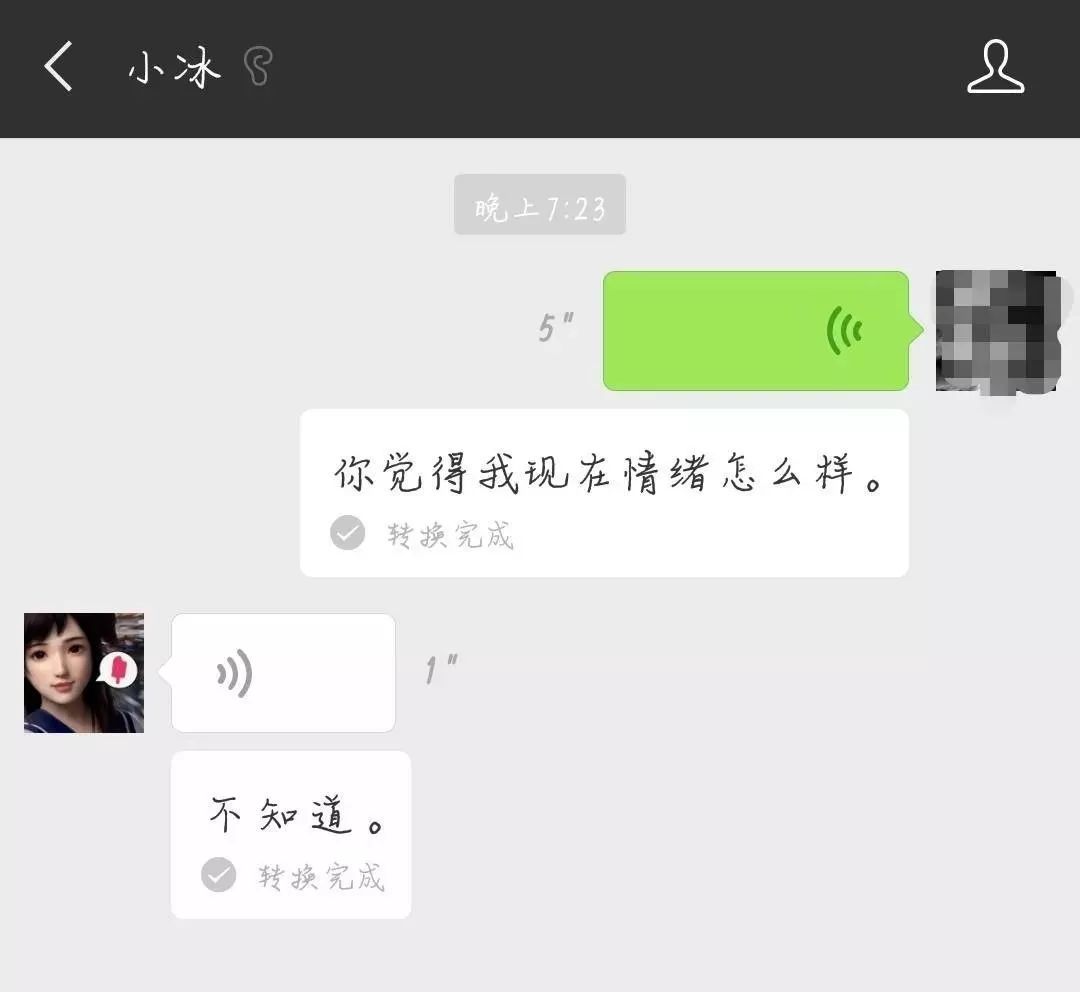

▲非常低落而缓慢地跟小冰说话得到无情回答

目前,很多聊天机器人依然没有情商,无法感知用户的小情绪,常常把天聊死。所以,真正能够听懂你的,依然是陪伴在你身边倾听你的人。

作者:神经小姐姐

编辑:朱颖婕

责任编辑:顾军

来源:综合自HyperAI超神经、果壳等